小規模言語モデルSLMアプリ開発

小規模言語モデルを活用した

対話型AIアプリケーション開発を行います

SLM(小規模言語モデル)とは

早く・安く・環境を問わない

軽量かつ小型言語モデル

SLM(小規模言語モデル)は、LLM(大規模言語モデル)よりもサイズが小さく軽量化された言語モデルです。高速なトレーニングと推論が可能で、リソース効率も高まり、コストパフォーマンスに優れています。

また、リソースに制約のあるデバイスやエッジコンピューティングに適しており、セキュアで機密性が高いと言った様々な特徴があります。より小型となる言語モデルの可能性が生成AIカテゴリーで注目されており、小規模言語モデルの採用が増加しています。

代表的なSLMとして「Phi-4」「Claude Haiku 4.5」「GPT-5.4 mini/nano」が挙げられます。

当社ではオンデバイスSLM(ローカル/エッジ/モバイルで動く生成AI)を目的にPhiシリーズを検証に取り込んでおり、SLMとVLMを統合した小規模画像モデルである「Phi-4-multimodal-instruct」「nanoVLM」「Live LLaVA」にも取り組んでおります。

当社について

Microsoft AI Innovation Partner of the Year 2024

「AI イノベーション パートナー オブ ザ イヤー アワード」は、マイクロソフト製品の活用によってAI分野で革新を起こしたパートナーに贈られるアワードとして2024年に新設され、ヘッドウォータースは同分野において最も優れた実績をあげたとの評価を受けた結果、初代受賞パートナーとなりました。

当社では、生成AIを積極的に導入して豊富な案件実績と先進的な事例公開、並びにAIの活用支援サービスのラインナップも拡充しております。

上位パートナー認定資格「Microsoft Azure の AI Platform/Agentic DevOps」 Specialization取得

ヘッドウォータースは「Microsoft Solutions Partner for Digital & App Innovation(Azure)」の認定を受け、さらに上位資格であるSpecializationとして「AI Platform on Microsoft Azure」「Agentic DevOps with Microsoft Azure and GitHub」の2領域を取得しています。

Specializationは厳格な技術要件と導入実績を満たしたパートナーのみに付与される称号であり、2領域での同時取得は国内でも極めて限られています。Azure上のAI基盤構築からGitHubを活用したエージェント駆動のDevOps自動化まで、Microsoftエコシステムを横断的にカバーできる技術力が、私たちのSLM導入支援の確かな土台です。

Azure OpenAI Service

リファレンスアーキテクチャAdvancedパートナー

当社はAzure OpenAI Serviceリファレンスアーキテクチャ賛同プログラムのAdvancedパートナーに認定されております。

「Azure OpenAI Service リファレンスアーキテクチャ」とは、Microsoft社が推奨する Azure OpenAI Service の活用シナリオ例と、そのシナリオに沿ったアプリケーションデモ動画やアーキテクチャ構成を詳しく説明しており、賛同パートナーには、マイクロソフト社からリファレンスアーキテクチャの情報が素早く共有され、技術支援やマーケティング支援を提供するプログラムが展開されます。

当社では、Azure OpenAI Serviceを使ったソリューションを多く提供しており、生成AIとAzureを組み合わせたソリューション開発を行っております。

当社のできること

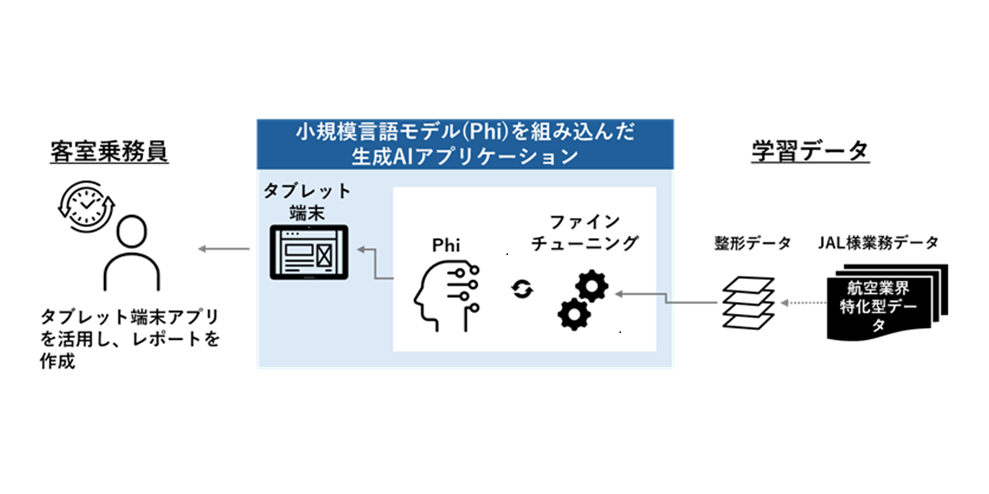

日本航空(JAL)様

オフラインでの客室乗務員レポート作成業務効率化SLM

JAL様では、客室乗務員から空港地上スタッフへの引き継ぎのためのレポート作成における業務効率化が課題となっています。そこで富士通とヘッドウォータースは、クラウド環境へのネットワーク接続が必要となる従来の大規模言語モデルに代わり、オフライン環境での性能に強みを持つ小規模言語モデル(SLM)であるマイクロソフトの「Phi-4 mini」を活用し、フライト中の機内においてタブレット端末上でチャット形式でのレポート作成が可能な生成AIソリューションのプロトタイプアプリを開発しました。

パイオニア様

二輪車向けUXソリューション「Pioneer Ride Connect」

パイオニア株式会社が展開する二輪車向けUXソリューション「Pioneer Ride Connect」の先行開発において、AI技術を活用したUX機能の実装支援を行いました。

本開発の核となるのは、軽量かつ高性能なAIモデル「SLM(Small Language Model)」を活用したAIエージェントです。走行中でも自然な発話で操作できるよう設計された「AI-powered Voice HMI」を実装し、会話の流れを汲み取ったストレスのない操作体験を検証しました。端末上での処理を優先する構成により、大規模なクラウドや不安定な通信環境に左右されない、高速で安定した動作を可能にしています。

これにより、ライダーは運転を妨げられることなく必要な情報を把握でき、走行の安全性と快適性が大幅に向上します。本サービスは「CES 2026」にも展示され、次世代のコネクテッドクラスターにおける新たな価値として注目されています。

SLMハイブリッド

ファインチューニング

「Phi-3」、「Llama-3」、並びに「GPT-4o mini」を中心とした小規模言語モデルを使用して、生成AIの回答精度を向上させるサービスを提供しています。

SLMの主な特徴は、「LLMの軽量化」にありますが、その他の特徴として「扱うデータ量が少ない」事にあります。

SLMの学習データとして「業界固有の用語やニュアンス」や「間違ってはいけない回答」など「他のナレッジよりも優先するべきナレッジ」をSLMに用意することで、不正確さや無関係な情報を生成するリスクを最小限に抑える事ができます。

さらにSLMはLLMと比較してコンピューティングリソースが抑えられる為、運用コスト効率が高く、応答時間の短縮や消費エネルギー削減と言ったメリットがあります。

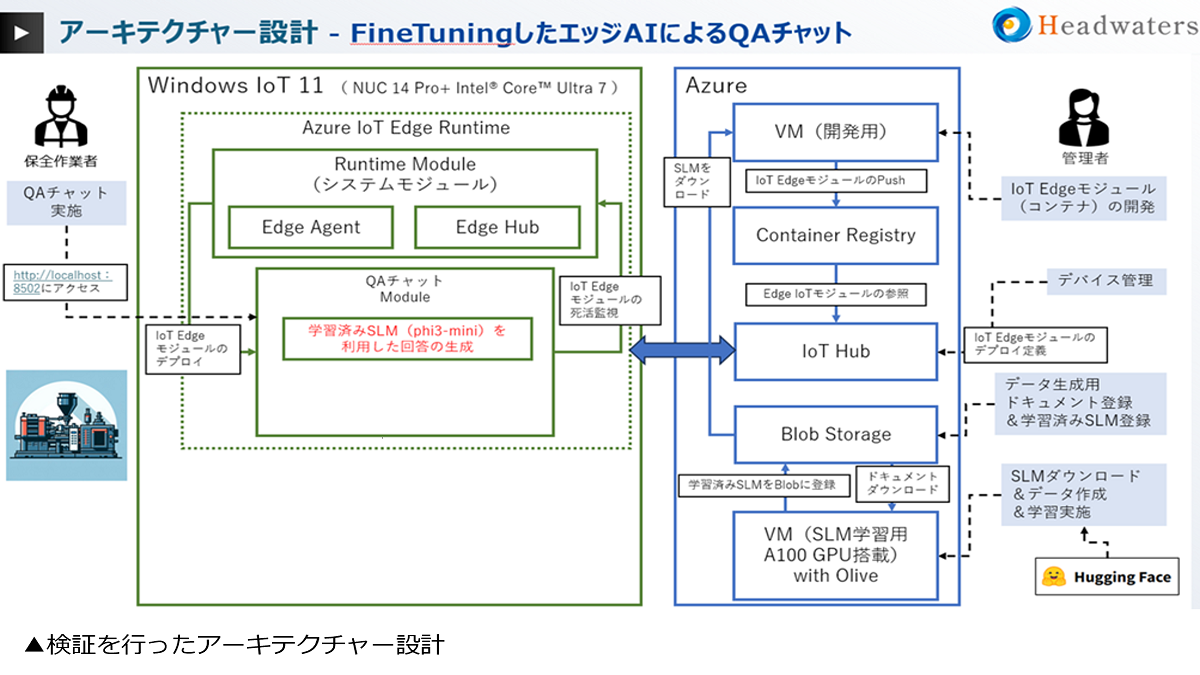

Microsoft IoT Edge×Phi-3量子化

LoRA/QLoRAファインチューニング

当社では、Microsoft Oliveを活用したモデル量子化・LoRA/QLoRAファインチューニングにより、PhiモデルなどのSLMを業務に特化した形で適用し、モデルの多様性(mini、small、medium、vision)とマルチモーダル処理能力を活かしたテキストと画像処理の適用範囲を検証しています。

「Azure IoT Edge for Linux on Windows(EFLOW)」や、iotedge-compose、Azure IoT Edgeランタイムを活用した、SLMアプリケーションの開発やデプロイメント効率化、Azure VM上のファインチューニング、Azure IoT Edge、Azure Container Registryを活用したクラウドとエッジによるデータ連携の有効性、さらにDirectML 、CUDA、ONNXランタイムをサポートすることで、様々なハードウェア環境への適用性についても検証しております。

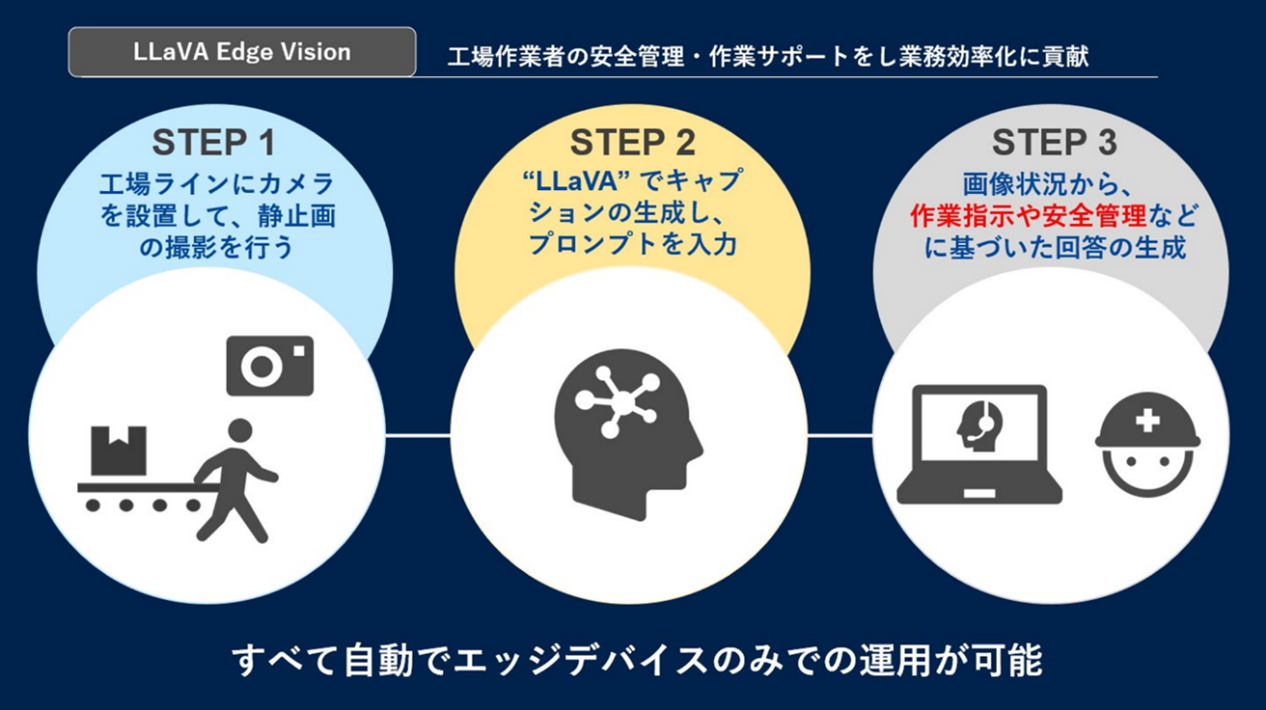

エッジでの軽量マルチモーダル生成AIを実現する

LLaVA Edge Vision

「LLaVA Edge Vision」は、半導体や自動車などの製造工場向けエッジ生成AIソリューションです。生成AIが製造ラインのカメラ画像に対してキャプションを生成し、作業員のタブレットやスマートフォンに作業指示や危険予知を通知することで、業務効率や安全性の向上に貢献いたします。また、エッジAI上でローカル VLM「LLaVA」( Large Language-and-Vision Assistant )を稼働させることで、生成速度や精度の向上を実現しております。

生成AI×エッジAI活用の

SLM/VLM

ヘッドウォータースでは、生成AI×エッジAI領域の取り組み強化を目的に、日本マイクロソフトのSLM「Phi-2/Phi-3」と、Meta社の「LLaMA」をベースとしたオープンソースSLM「TinyLlama」、ならびにVLM「LLaVA」をNVIDIAの「NVIDIA® Jetson Orin™ Nano」上で検証することによって、エッジAIと生成AIを組み合わせたビジネス活用方法の整理と活用拡大に向けたアーキテクチャー構築を行っています。

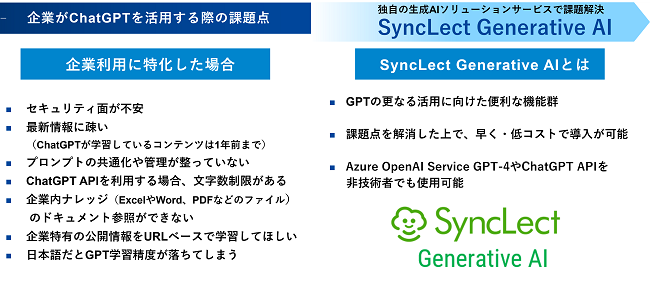

独自データ学習の生成AI活用プラットフォーム

SyncLect Generative AI

SyncLect Generative AIは、ChatGPT単体ではできない機能課題に対する強化・拡張を行うためのLLMライブラリ「LangChain」をMicrosoft Azure環境に最適化したプラットフォームで、ChatGPTカスタム済みの機能を提供します。また、本サービスの利用者はチャット画面上からモード切替を選択することで、独自学習済みの対話エージェントを呼び出して利用することも可能になります。

生成AI×モバイルアプリ

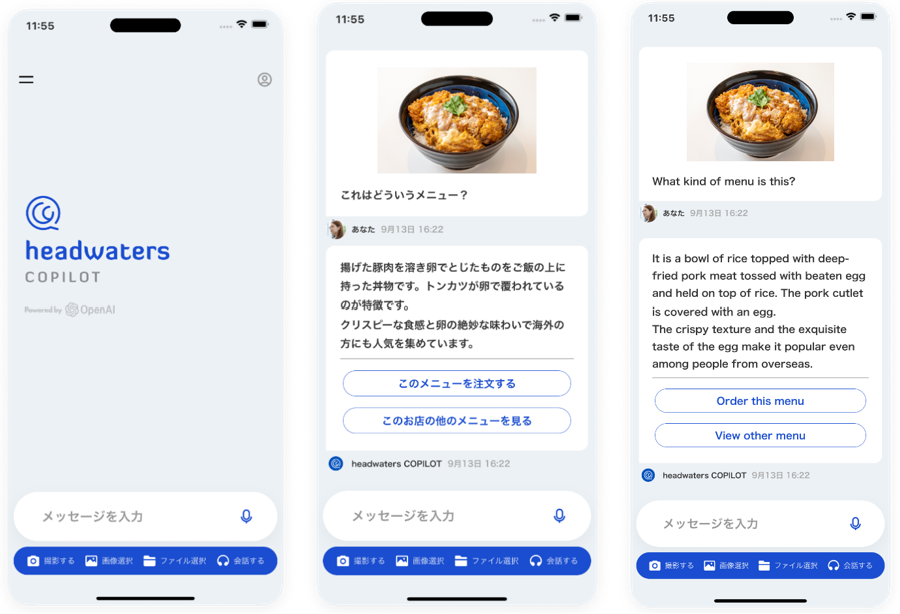

マルチモーダル AI Mobile App Copilot

「マルチモーダルAI Mobile App Copilot」は、BtoCビジネス企業に対して、企業独自のデータを学習したRAG型Copilotをエンドユーザー向けモバイルアプリに搭載する開発支援サービスです。

アプリユーザーの「副操縦士(Copilot)」として、企業独自Copilotエージェントがマルチターンで会話を行い、複雑なタスクの手助けをしてくれるモバイルアプリとUX、モバイルバックエンドを一気通貫で提供いたします。

テキスト、音声、画像・映像の複合的な生成AI支援

マルチモーダルAIラボ

マルチモーダルAIとは、様々な種類の情報を利用して高度な判断を行うAIを指します。大規模言語モデルは、マルチモーダルAIモデルによってテキストの枠を超え、ユーザーはテキスト、音声、画像、動画をベースに新しいコンテンツを生成できるようになりました。

業務活用のため企業内に眠る様々なファイル形式のデータを生成AIに学ばせて、企業の独自ナレッジを利用した生成AIのカスタムニーズに対応いたします。

LLM技術のナレッジシェアと伴走支援を行う

プロンプトエンジニアリングラボ

当社の生成AIエンジニアやプロンプトエンジニアを本サービスの利用顧客向けに個別体制を構築し、法人顧客のAzure OpenAI ServiceやChatGPTの活用習熟度に合わせ、伴走型支援を行うサービスです。

生成AIやプロンプトエンジニアリングの基礎知識を提供するワークショップやハンズオン形式セミナーの開催、1日から始められる「Power Platform×Azure OpenAI Service」チャットボットの試験導入、業務活用に向けた企画支援、プロトタイプアプリ構築、プロンプトエンジニアによるテクニカルアドバイザリー、高セキュリティを実現するエンタープライズ向けAzureアーキテクチャの設計構築支援、社内データを横断検索しAzure OpenAI モデルに回答を学ばせるCognitive Searchモデルや専用Web UI、外部データ利用モデルの構築を提供します。

Azure OpenAI Service × 音声

自動音声認識(Automated Speech Recognition:ASR)でユーザーの質問内容をテキスト変換し、「Azure OpenAI Service」に繋げることで「音声認識×GPT」を今までよりも素早く提供できるようになりました。

「音声認識×GPT×音声合成による音声対話」や「音声認識後のGPT活用」を行うAIシステムの提供を行っており、

業界の専門用語が数多く出る場面においては「Azure Custom Voice」を利用することで業界の専門用語をAzure上でカスタムトレーニングし、「SyncLect」が持つマルチプラットフォーム機能により、任意のWebやアプリから「音声認識×GPT」機能を追加することができます。

入力デバイスとなるマイクもPCやスマートデバイス、エッジデバイスに接続された任意のマイクが利用でき、モバイル、車載、店頭、オフィス、デジタルサイネージなど様々なシーンで利用可能です。

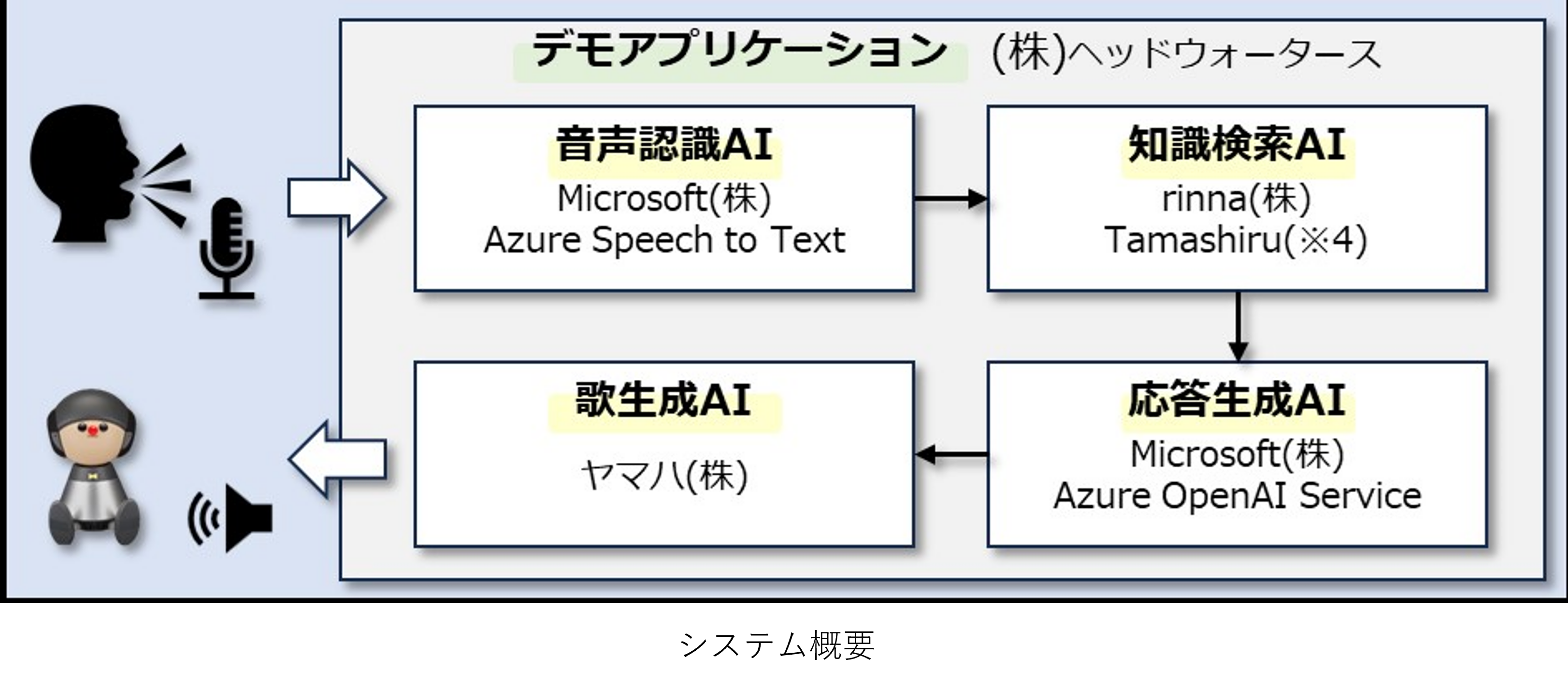

ヤマハ発動機株式会社様

音声対話×歌生成AI搭載型ロボット

ジャパンモビリティショー2023に展示するAIロボット「Charlie(チャーリー)」において、rinna株式会社と共同で、歌生成AI・音声認識AI・知識検索AI・応答生成AI(Chat GPT)を組み合わせたデモアプリケーションの開発支援を行いました。

AIロボット「Charlie」がユーザ(来場者)からの質問(音声入力)に対して関連する知識を検索し、Chat GPTで応答文を生成、それを歌生成AIが歌声に変えて回答いたします。